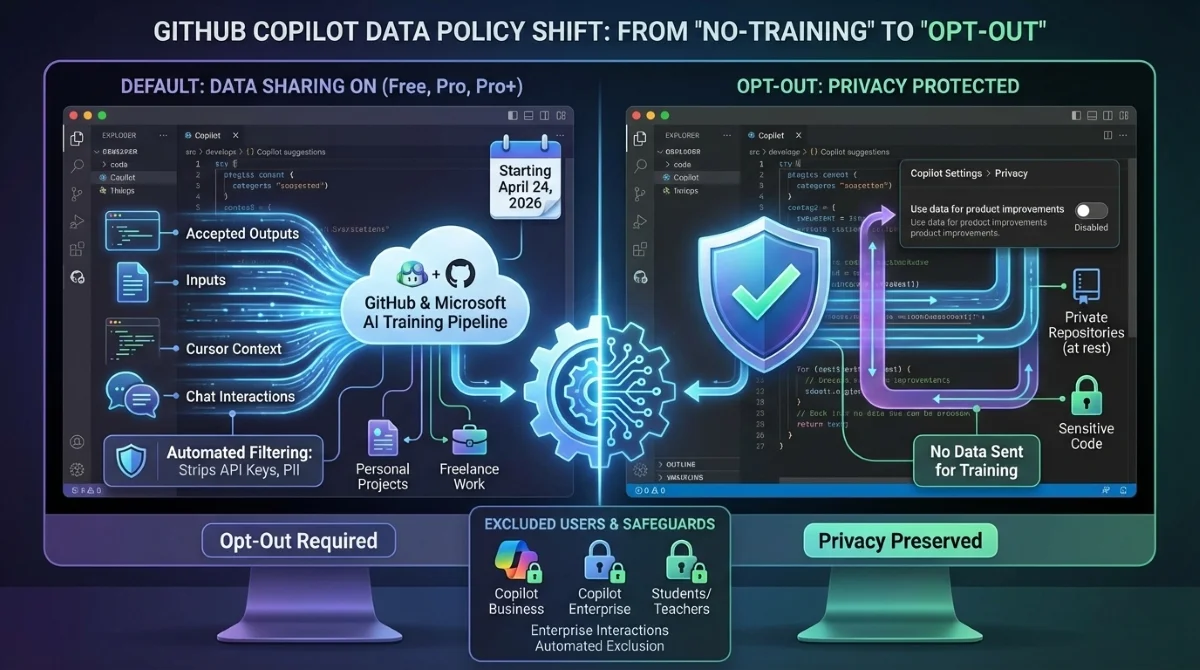

تُجري منصة GitHub تغييراً جذرياً في كيفية تعاملها مع بيانات المطورين، حيث أعلنت أنه بدءاً من 24 أبريل 2026، ستستخدم بيانات التفاعل من مستخدمي أداة Copilot بخطط Free، وPro، وPro+ لتدريب نماذج الذكاء الاصطناعي الخاصة بها. ويتوافق هذا النهج مع ممارسات الصناعة المعمول بها، ولكنه ينقل المنصة من موقف صارم يمنع التدريب إلى نموذج يعتمد على إلغاء الاشتراك للمطورين الأفراد. ويظل مستخدمو خطط Copilot Business وCopilot Enterprise معفيين تماماً من هذا التحديث.

بالنسبة إلى 26 مليون مطور يعتمدون على مساعد الذكاء الاصطناعي، يعني هذا أن مقتطفات الأكواد البرمجية النشطة، والمطالبات، وتفاعلات الدردشة ستتم تغذيتها مرة أخرى في النظام بشكل افتراضي. وإذا كنت تعمل على مشاريع شخصية ذات ملكية خاصة أو أعمال مستقلة حساسة، فيجب عليك اتخاذ إجراء فوري لحماية قاعدة الأكواد البرمجية الخاصة بك. وتجادل منصة GitHub بأن هذا التحول ضروري لبناء نماذج أكثر ذكاءً وإدراكاً للسياق يمكنها فهم سير عمل التطوير المعقد بشكل أفضل.

وبعد اختبار هذا النهج بنجاح باستخدام البيانات الداخلية لموظفي شركة Microsoft، تدعي الشركة أن بيانات التفاعل في العالم الحقيقي تعمل على تحسين قدرة الذكاء الاصطناعي بشكل كبير على اكتشاف الأخطاء واقتراح أنماط دقيقة. وتؤكد الشركة أن مستقبل التطوير المدعوم بالذكاء الاصطناعي يعتمد على بيانات التفاعل في العالم الحقيقي، متجاوزاً النماذج الأولية التي تم بناؤها حصرياً على البيانات المتاحة للجمهور وعينات الأكواد المصممة يدوياً.

ما هي البيانات التي تجمعها GitHub (وما هي البيانات الآمنة)

تلقي السياسة الجديدة بشبكة واسعة على جلسات البرمجة النشطة. ومع ذلك، تنص منصة GitHub صراحةً على أنها لن تسحب الأكواد من المستودعات الخاصة "أثناء السكون"، مما يعني أنها تلتقط فقط ما ترسله بنشاط إلى النموذج أثناء الجلسة المباشرة.

- البيانات المجمعة: المخرجات المقبولة أو المعدلة، والمدخلات المرسلة إلى أداة Copilot، وسياق المؤشر، والتعليقات، وهيكل المستودع، وتفاعلات الدردشة.

- المستخدمون المستثنون: مستخدمو خطط Copilot Business، وCopilot Enterprise، وCopilot Student، والمعلمون الذين لديهم وصول مجاني إلى خطة Copilot Pro.

- حماية المؤسسات: إذا تعاون حساب شخصي في مستودع تابع لمؤسسة مدفوعة، فسيتم استبعاد بيانات التفاعل هذه تلقائياً من التدريب.

ولمعالجة المخاوف الأمنية، نفذت منصة GitHub تصفية آلية مصممة لإزالة المعلومات الحساسة مثل مفاتيح واجهة برمجة التطبيقات، وكلمات المرور، ومعلومات التعريف الشخصية قبل وصول البيانات إلى مسار التدريب. وستتم مشاركة البيانات فقط مع الشركات التابعة لمنصة GitHub، وفي مقدمتها شركة Microsoft، ولن يتم بيعها لموفري نماذج الذكاء الاصطناعي من جهات خارجية.

كيفية إلغاء الاشتراك في جمع بيانات Copilot

إذا كنت تفضل الحفاظ على خصوصية عاداتك البرمجية، تتيح لك منصة GitHub إلغاء الاشتراك في جمع البيانات هذا بالكامل. وإذا قمت مسبقاً بتعطيل جمع المطالبات والاقتراحات، فستحترم المنصة هذا التفضيل الحالي تلقائياً.

- انتقل إلى إعدادات حساب GitHub الخاص بك.

- انقر على قسم Copilot في الشريط الجانبي.

- انتقل إلى علامة التبويب Privacy.

- قم بتعطيل الإعداد الذي يسمح لمنصة GitHub باستخدام بياناتك لتحسينات المنتج.

رؤيتنا التحليلية لاستراتيجية بيانات GitHub

يسلط تحديث السياسة هذا الضوء على محور حاسم في سباق تسلح الذكاء الاصطناعي، وهو الانتقال من استخلاص البيانات العامة إلى حصد تفاعلات المستخدمين النشطة. ومن خلال جعل هذه السياسة تعتمد على إلغاء الاشتراك بدلاً من الاشتراك الطوعي، تستفيد منصة GitHub من القصور الذاتي لقاعدة مستخدميها الضخمة لتأمين مجموعة بيانات تدريبية عالية الجودة من العالم الحقيقي. وحقيقة أن بيانات موظفي شركة Microsoft قد أسفرت بالفعل عن "تحسينات مجدية" تثبت أن البيانات الاصطناعية لم تعد كافية للحفاظ على ميزة تنافسية.

وبينما تبرر منصة GitHub ذلك بالإشارة إلى تحركات مماثلة من قبل شركتي Anthropic وJetBrains، فإن قرار استبعاد عملاء المؤسسات مع إشراك مستخدمي خطة Pro الفرديين افتراضياً في مشاركة البيانات يخلق نظاماً متدرجاً للخصوصية. ويجب على المطورين الآن التعامل مع محرر الأكواد الخاص بهم كمشارك نشط في تدريب الذكاء الاصطناعي، مما يجعل زر إلغاء الاشتراك خطوة أولى إلزامية لأي شخص يتعامل مع أكواد برمجية حساسة غير تابعة للمؤسسات.