تحول تشغيل الذكاء الاصطناعي المحلي في عام 2026 من عبء يتطلب أجهزة قوية إلى حل سلس ومجاني للمطورين والمستخدمين المهتمين بالخصوصية. وبينما تواصل شركات الحوسبة السحابية العملاقة مثل منصة ChatGPT ونظام Gemini إطلاق نماذج ضخمة، تبددت تماماً المخاوف من أن تصبح المعالجة المحلية على الأجهزة تقنية عفا عليها الزمن. واليوم، يعد تشغيل النماذج اللغوية القوية محلياً ضرورة جاهزة للإنتاج لتجنب تكاليف واجهة برمجة التطبيقات (API) الباهظة وحماية البيانات الحساسة.

يستهدف هذا الدليل بشكل خاص المطورين والباحثين والشركات التي تتطلع إلى دمج الذكاء الاصطناعي دون المساومة على الخصوصية أو الميزانية. ومن خلال الانتقال إلى النماذج المحلية، يمكن للمستخدمين تحقيق التشغيل دون اتصال بالإنترنت وإلغاء التكلفة لكل رمز (Token)، مما يغير جذرياً كيفية نشر أدوات الذكاء الاصطناعي المؤسسية والشخصية. وقد وثق مجتمع r/LocalLLaMA عبر منصة Reddit هذا التحول بشكل مكثف، مما يثبت أن الإعدادات المحلية أصبحت الآن الخيار الافتراضي للعديد من مسارات العمل.

التحول التقني: لماذا صمدت النماذج المحلية

قبل بضع سنوات، كان تشغيل نموذج لغوي قادر محلياً يتطلب تنازلات كبيرة في الأجهزة وتكوينات معقدة. واليوم، اختفى هذا العائق تقريباً، مما سمح للنماذج التي تتراوح بين 4 مليارات إلى 8 مليارات معلمة بالتعامل مع المهام اليومية بطلاقة على حاسوب محمول قياسي. علاوة على ذلك، تعمل النماذج المكممة التي تتجاوز 30 مليار معلمة الآن بشكل مدهش على بطاقات الرسوميات الاستهلاكية من الفئة المتوسطة.

وفقاً للتحليلات المتخصصة في الصناعة، دفعت العديد من الاختراقات التقنية الرئيسية هذا التحول الهائل في سهولة الوصول. وقد سمحت هذه الابتكارات للمطورين بتجاوز مزارع الخوادم الضخمة التي كانت مطلوبة سابقاً لعمليات الاستدلال (Inference) المتقدمة.

- معمارية مزيج الخبراء (MoE): قللت هذه الهيكليات من متطلبات الحوسبة بنسبة تتجاوز 70% مع الحفاظ على أداء عالي المستوى.

- التكميم المتقدم (Quantization): أدى اعتماد تقنيات التكميم بمعيار 4 بت و5 بت إلى تقليص أحجام النماذج بشكل كبير دون فقدان كبير في الجودة.

- النماذج المتخصصة في مجالات محددة: تتفوق النماذج الأصغر والمركزة الآن بشكل متكرر على النماذج السحابية العامة الأكبر حجماً في مهام محددة وموجهة.

الذكاء الاصطناعي المحلي مقابل السحابي: مشهد عام 2026

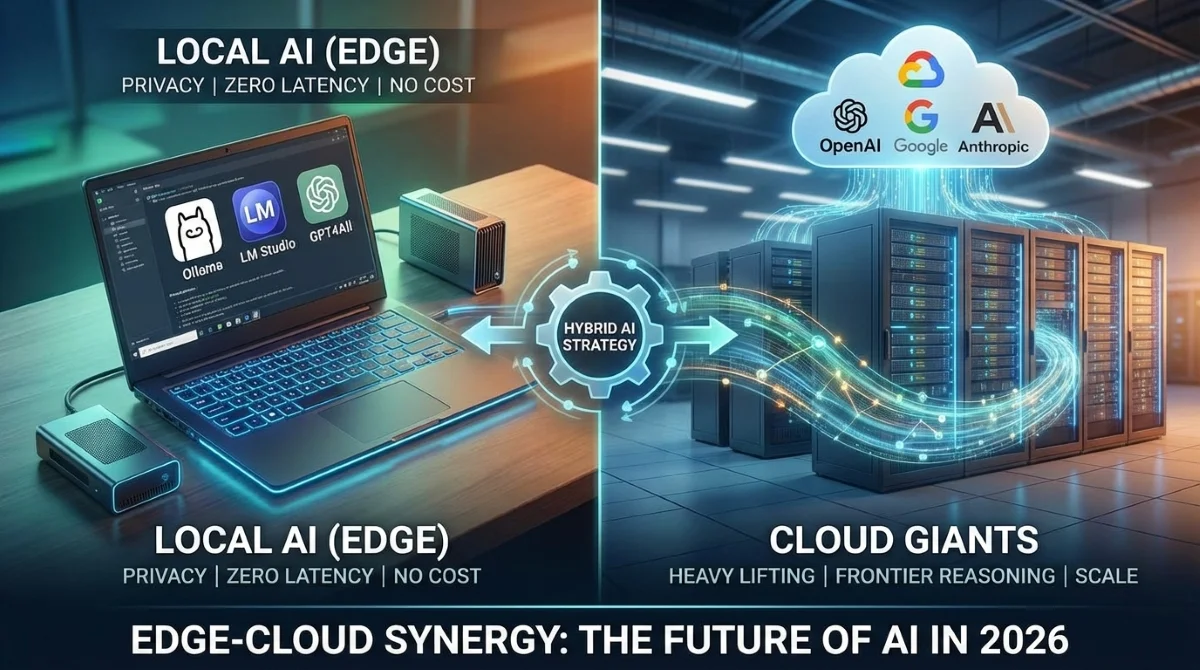

لم يعد القرار بين البنية التحتية المحلية والسحابية يتعلق بأيهما أفضل بطبيعته، بل يتعلق بالأداة التي تناسب المهمة المحددة. تقدم النماذج المحلية مزايا ملموسة لا يمكن للخدمات السحابية مضاهاتها، خاصة فيما يتعلق بسيادة البيانات. ومع ذلك، وكما لوحظ في المقارنات الحديثة، لا تزال المنصات السحابية تهيمن عندما تكون هناك حاجة إلى قوة حوسبة خام.

| الميزة | نماذج الذكاء الاصطناعي المحلية | خدمات الذكاء الاصطناعي السحابية |

|---|---|---|

| خصوصية البيانات | خاصة بنسبة 100%؛ لا تغادر المطالبات الجهاز أبداً. | تتم معالجة البيانات على خوادم الشركات الخارجية. |

| تكلفة التشغيل | تكلفة صفرية لكل رمز؛ لا توجد اشتراكات شهرية. | تُطبق رسوم متكررة على واجهة برمجة التطبيقات وحدود للاستخدام. |

| زمن الاستجابة (Latency) | زمن استجابة منخفض للغاية (بين 10 إلى 50 مللي ثانية). | زمن استجابة أعلى (بين 100 إلى 500+ مللي ثانية). |

| قوة الاستدلال | ممتازة للمهام اليومية والمساعدة في كتابة الأكواد. | متفوقة في الاستدلال المتقدم (Frontier Reasoning) والمنطق المعقد. |

| متطلبات الأجهزة | تتطلب معالجاً قوياً أو بطاقة رسوميات من الفئة المتوسطة. | لا تتطلب أجهزة محلية؛ تتوسع قدراتها على الفور. |

أبرز النماذج والأدوات التي يمكنك تجربتها

أصبح إعداد بيئة محلية الآن مسألة دقائق بدلاً من أيام. وقد بسطت أدوات مثل تطبيق Ollama وبرنامج LM Studio ونظام GPT4All عملية التثبيت، حيث تقدم واجهات بديهية لإدارة نماذج متعددة. وبالنسبة للمطورين، يلتف المجتمع حالياً حول نموذج Qwen 3 Coder 80B للحصول على مساعدة برمجية متقدمة.

للاستخدام العام، تظل عائلة نماذج Llama 3 الخيار الأفضل في جميع أنحاء الصناعة. ويتنافس الإصدار الذي يحتوي على 70 مليار معلمة من نموذج Llama 3 بشكل مباشر مع نموذج GPT-4 في مهام الاستدلال المعقدة. وبينما يمكن لنموذج بحجم 4 مليارات معلمة أن يحل محل منصة ChatGPT إلى حد كبير في الكتابة والتلخيص اليومي، لا تزال الأبحاث العميقة تستفيد من الهيكليات الأكبر.

رأيي: عصر البنية الهجينة قد بدأ

لقد تمت الإجابة بشكل قاطع على الجدل حول ما إذا كان الذكاء الاصطناعي المحلي قد انتهى من خلال مقاييس الأداء الهائلة التي نشهدها في عام 2026. عندما تعمل المعالجة المحلية بزمن استجابة (Latency) منخفض للغاية يتراوح بين 10 إلى 50 مللي ثانية مقارنة بـ 100 إلى 500 مللي ثانية المطلوبة للطلبات السحابية، فإن تجربة المستخدم على الجهاز تتفوق بلا شك في المهام السريعة. هذه الميزة في السرعة، إلى جانب الخصوصية المطلقة للبيانات، تجعل النماذج المحلية لا غنى عنها لتطبيقات الشركات.

ومع ذلك، فإن النهج الأكثر ذكاءً للمضي قدماً هو الاعتماد على بنية هجينة. وكما أشير في النقاشات المعمارية الحديثة، فإن الاعتماد حصرياً على نظام بيئي واحد يحد من الإمكانات. يجب على المستخدمين نشر النماذج المحلية للمهام الخاصة أو المتكررة أو الحساسة للتكلفة، مع الاحتفاظ بالنماذج السحابية لمهام الاستدلال الثقيلة أو المهام التي تتطلب نوافذ سياق (Context Windows) ضخمة تتجاوز مليون رمز (Token).

أفادك المقال؟ شاركه مع مطوّر لسه بيدفع زيادة على الـ APIs.