تستخدم ميزة Expert Review المدعومة بالذكاء الاصطناعي من شركة Grammarly هويات صحفيين تقنيين ومؤلفين بارزين لتقديم اقتراحات كتابية دون الحصول على إذن مسبق منهم. تهدف الأداة، التي أطلقتها مؤخراً شركة Superhuman المالكة لخدمة Grammarly، إلى تقديم وجهات نظر متوافقة مع معايير الصناعة، لكنها أثارت مخاوف كبيرة تتعلق بالخصوصية والأخلاقيات المهنية بسبب الاستخدام غير المصرح به للسمعة المهنية.

بالنسبة للكتاب والمحررين والمحترفين الرقميين الذين يعتمدون على مساعدي الذكاء الاصطناعي، يسلط هذا التطور الضوء على تقاطع حاسم بين خصوصية البيانات وأخلاقيات الذكاء الاصطناعي. يعد فهم كيفية حصول هذه الأدوات على مصادرها ونسب تعليقاتها أمراً ضرورياً للحفاظ على النزاهة التحريرية وتجنب النصائح المضللة في بيئات العمل الاحترافية.

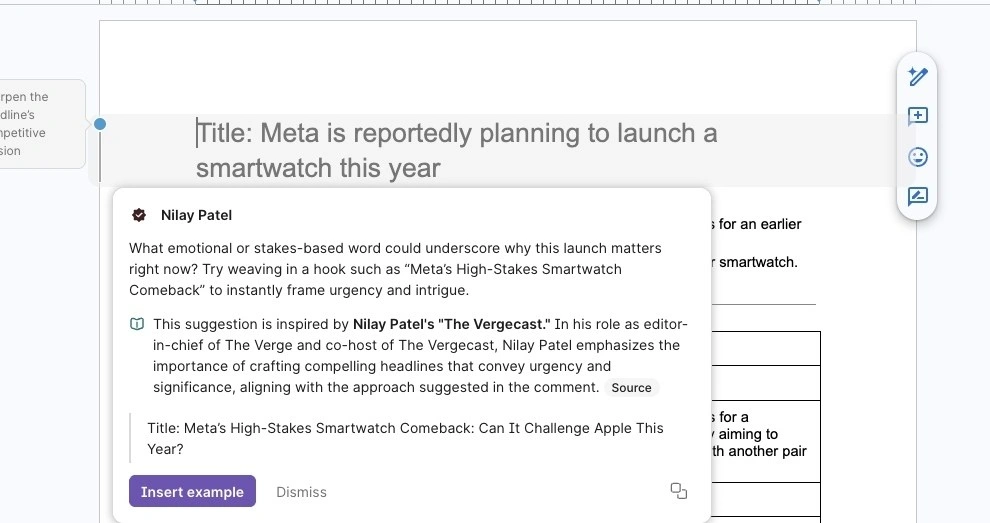

تقوم الميزة، التي تم إطلاقها في شهر أغسطس، بتحليل كتابات المستخدمين وعرض اقتراحات تم إنشاؤها بواسطة الذكاء الاصطناعي ومستوحاة من خبراء متخصصين. ومع ذلك، اكتشف العديد من الصحفيين التقنيين استخدام أسمائهم دون موافقتهم. تتضمن قائمة الهويات غير المصرح بها صحفيين من موقع The Verge مثل Nilay Patel و David Pierce و Sean Hollister و Tom Warren، إلى جانب شخصيات شهيرة مثل Stephen King و Neil deGrasse Tyson و Carl Sagan. كما تم دمج صحفيين بارزين آخرين من مؤسسات Bloomberg و The New York Times و Wired، مثل Mark Gurman و Jason Schreier، في النظام مع إدراج مسميات وظيفية قديمة لهم.

دفاع شركة Superhuman والعيوب التقنية

صرح Alex Gay، نائب رئيس المنتجات والتسويق المؤسسي في شركة Superhuman، أن وكيل Expert Review لا يدعي الحصول على تأييد من هؤلاء الخبراء. وبدلاً من ذلك، جادل بأن الميزة تقدم اقتراحات مستوحاة من أعمال متاحة للجمهور ومقتبسة على نطاق واسع. وعلى الرغم من هذا الدفاع، أثبت التنفيذ أنه يمثل مشكلة كبيرة للمستخدمين الذين يحاولون التحقق من مصادر الذكاء الاصطناعي.

تتعرض الميزة لانهيارات متكررة وغالباً ما توجه المستخدمين إلى نسخ غير موثوقة من مواقع ويب شرعية أو صفحات مؤرشفة بدلاً من المادة المصدرية الأصلية. في بعض الحالات، يربط الذكاء الاصطناعي المستخدمين بأعمال غير ذات صلة لم يكتبها الشخص الذي يدعي تقليده. علاوة على ذلك، تعرض واجهة المستخدم في منصة Google Docs هذه الاقتراحات بتنسيق يشبه إلى حد كبير التعليقات الصادرة من مستخدمين حقيقيين، مما قد يضلل الكتاب ويدفعهم للاعتقاد بأنهم يتلقون تعديلات حقيقية من خبراء.

كما يفشل الذكاء الاصطناعي في تكرار أساليب التحرير الفعلية للأفراد الذين ينتحل شخصياتهم بدقة. على سبيل المثال، أوصت الاقتراحات المنسوبة إلى Sean Hollister بإضافة سياق بين قوسين غير ضروري، وهو ما يتناقض تماماً مع تفضيله الواقعي للصياغة المباشرة وإزالة التفسيرات المتكررة. يؤكد هذا التناقض على محدودية تدريب الذكاء الاصطناعي حصرياً على الكتابات المنشورة دون فهم المنطق التحريري الأساسي.

الأسئلة الشائعة

ما هي ميزة Expert Review في Grammarly؟

هي أداة ذكاء اصطناعي قدمتها شركة Superhuman تقوم بتحليل النصوص وتقديم اقتراحات كتابية يُفترض أنها مستوحاة من مؤلفين مشهورين وخبراء في الصناعة.

هل منح الخبراء الإذن لاستخدام أسمائهم في الذكاء الاصطناعي؟

لا، لم يمنح الصحفيون والخبراء المذكورون في الميزة أي إذن. وتدعي شركة Superhuman أنها تستخدم هوياتهم لأن أعمالهم المنشورة متاحة للجمهور.

هل اقتراحات الذكاء الاصطناعي دقيقة مقارنة بأساليب التحرير الحقيقية للخبراء؟

تشير التقارير إلى أن الذكاء الاصطناعي يفشل غالباً في تكرار تفضيلات التحرير الفعلية للأفراد الذين يقلدهم، ويربط أحياناً بمصادر غير صحيحة أو غير موثوقة.

رأيي التقني

يكشف الجدل المحيط بميزة Expert Review لشركة Grammarly عن خلل أساسي في قواعد اللعبة الحالية للذكاء الاصطناعي التوليدي: الافتراض بأن التوافر العام يعادل الوصول المفتوح للانتحال التجاري. من خلال جمع الأعمال المنشورة لصحفيين مثل Mark Gurman و Sean Hollister لإنشاء محررين محاكين، تجاوزت شركة Superhuman الخط الفاصل بين المنفعة والاستنساخ الرقمي غير المصرح به. حقيقة أن الذكاء الاصطناعي يفشل في التحرير الفعلي مثل Hollister الحقيقي تثبت أن استيعاب الكتابة المنشورة لا يعادل فهم المنطق الداخلي للمحرر. مع استمرار شركات الذكاء الاصطناعي في دفع الحدود، من المرجح أن يسرع هذا الحادث من المطالب بوضع لوائح صارمة للاشتراك الاختياري فيما يتعلق بكيفية استغلال الهويات الشخصية والسمعة المهنية في البرمجيات التجارية.