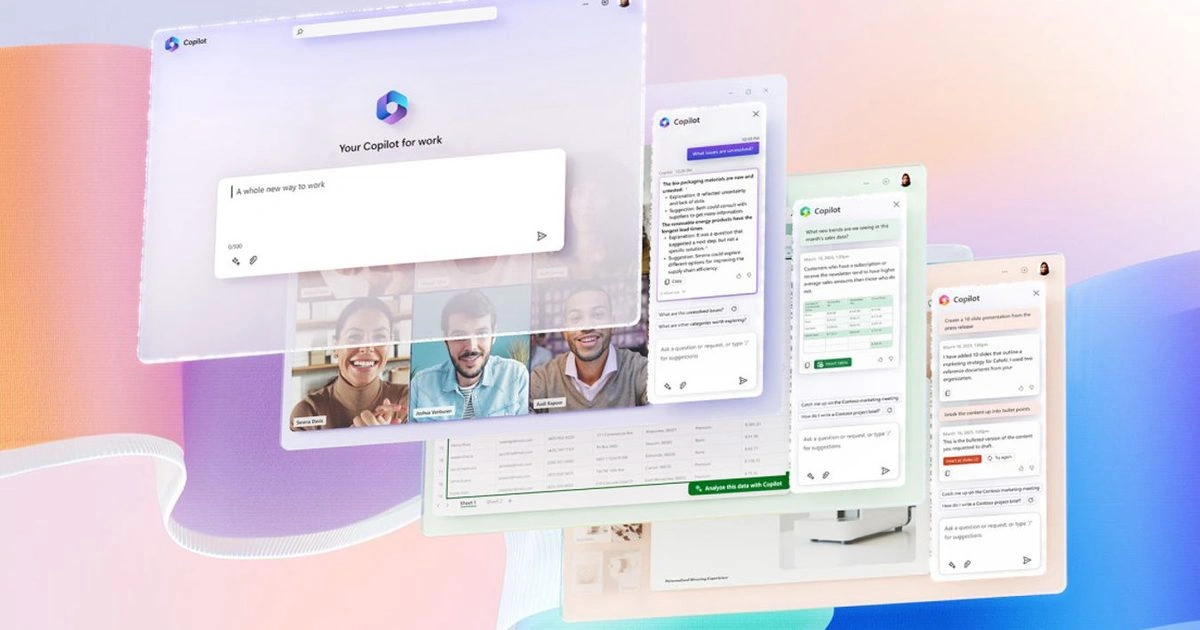

ظهر مؤخراً تهديد سيبراني متطور يعتمد على استغلال قدرات التصفح الشبكي المدمجة في روبوتات الدردشة الحديثة المدعومة بالذكاء الاصطناعي، مما يحول هذه المنصات الموثوقة إلى أدوات غير طوعية في أيدي المهاجمين. وقد أوضحت دراسة حديثة صادرة عن مؤسسة Check Point Research كيف يمكن للميزات المصممة لتعزيز إنتاجية المستخدمين، مثل قدرة المساعد الذكي Microsoft Copilot على جلب وتلخيص البيانات من الويب، أن تُستخدم للالتفاف على أنظمة الحماية التقليدية. تتيح هذه التقنية للبرمجيات الخبيثة الموجودة على الأجهزة المصابة التواصل مع مشغليها دون الحاجة لإنشاء اتصال مباشر مع خوادم مشبوهة، مما يجعل قوائم الحظر في جدران الحماية غير فعالة إلى حد كبير.

آلية عمل هجوم "الوسيط الذكي"

تعتمد هذه الثغرة الأمنية على تقنية أطلق عليها الباحثون اسم "المنتحل" (Imposter)، والتي تستثمر الثقة الممنوحة لشركات التكنولوجيا الكبرى داخل شبكات المؤسسات. في سيناريوهات الهجوم التقليدية، تحتاج البرمجيات الخبيثة إلى تلقي التعليمات من خادم القيادة والتحكم (C2)، وهو ما تكشفه عادةً برامج الأمان عند رصد اتصال بعنوان IP غريب. ولكن في هذا النمط الجديد، تقوم البرمجية الخبيثة بإرسال طلب نصي إلى روبوت الدردشة، تطلب منه "تلخيص" أو جلب محتوى من رابط URL محدد يسيطر عليه المهاجم. يقوم الذكاء الاصطناعي، بصفته وسيطاً موثوقاً، بزيارة الموقع الخبيث وجلب الأوامر المخفية داخل النصوص، ثم يعيد إرسالها إلى البرمجية الخبيثة عبر حركة البيانات المشفرة والشرعية الخاصة بمنصة الذكاء الاصطناعي.

تؤدي هذه العملية إلى تعتيم كامل لمصدر الأوامر الخبيثة، حيث تظهر حركة البيانات لمسؤولي الشبكات وكأنها تفاعل طبيعي مع خدمة موثوقة تابعة لشركة Microsoft أو غيرها. تقوم البرمجية الخبيثة بتحليل رد الذكاء الاصطناعي لاستخراج التعليمات المخفية وتنفيذها، بل ويمكنها تسريب البيانات المسروقة عن طريق الطلب من الذكاء الاصطناعي "نشر" المعلومات على موقع آخر يسيطر عليه المهاجم. يخلق هذا نفقاً ثنائي الاتجاه للاتصال يعتمد كلياً على سمعة النطاق الخاص بمزود خدمة الذكاء الاصطناعي، مما يجعل اكتشافه بواسطة أدوات الأمان المعتمدة على التواقيع أمراً بالغ الصعوبة.

موقف شركة Microsoft واستراتيجية الدفاع المتعمق

في ردها على هذه النتائج، أقرت شركة Microsoft بوجود هذا الخطر نظرياً، لكنها أكدت أن ما يحدث ليس ثغرة برمجية بالمعنى التقليدي، بل هو إساءة استخدام لميزة وظيفية. وتجادل الشركة بأن مسؤولية التصدي لهذا النوع من الهجمات تقع على عاتق استراتيجية "الدفاع المتعمق"، حيث يجب على المؤسسات مراقبة محتوى تفاعلات الذكاء الاصطناعي بدلاً من الاكتفاء بمراقبة نقاط الاتصال. ورغم أن الشركة تطبق إجراءات لمنع الذكاء الاصطناعي من زيارة النطاقات الخبيثة المعروفة، إلا أن الطبيعة الديناميكية للبنية التحتية لخوادم القيادة والتحكم تعني أن المهاجمين يمكنهم إنشاء مواقع جديدة تبدو حميدة لاستضافة أوامرهم بسرعة، مما ينقل عبء الحماية إلى فرق الأمان المؤسسي التي يجب عليها نشر أدوات تحليل سلوكي متقدمة.

مقارنة: الاتصال التقليدي مقابل الوسيط الذكي

| الميزة | اتصال القيادة والتحكم (C2) التقليدي | الترحيل عبر الذكاء الاصطناعي (Imposter) |

|---|---|---|

| نقطة الاتصال | اتصال مباشر بعنوان IP للمهاجم | نطاق ذكاء اصطناعي موثوق (مثل copilot.microsoft.com) |

| رؤية جدار الحماية | عالية (يتم حظر العناوين المشبوهة) | منخفضة (حركة البيانات مسموح بها) |

| تشفير البيانات | غالباً تشفير مخصص أو SSL قياسي | تشفير SSL عبر شهادة موثوقة للمزود |

| صعوبة الاكتشاف | منخفضة إلى متوسطة | عالية جداً |

الأسئلة الشائعة

كيف يعمل ترحيل البرمجيات الخبيثة عبر روبوتات الدردشة؟

تطلب البرمجية الخبيثة من روبوت الدردشة زيارة رابط محدد يسيطر عليه المخترق. يقوم الروبوت بجلب البيانات (الأوامر) من ذلك الموقع وعرضها للمستخدم (البرمجية الخبيثة)، ليعمل بذلك كوسيط يخفي خادم المخترق خلف النطاق الموثوق للذكاء الاصطناعي.

هل تستطيع برامج مكافحة الفيروسات الحالية كشف هذا الهجوم؟

تواجه معظم برامج الحماية التقليدية صعوبة في كشف هذا الأسلوب لأن حركة البيانات تبدو كاتصال شرعي بخدمة ذكاء اصطناعي آمنة. يتطلب الاكتشاف مراقبة سلوكية متقدمة تحلل محتوى الأوامر وليس فقط المصدر والوجهة.

هل قامت شركة Microsoft بإصلاح هذه الثغرة؟

لا تصنف شركة Microsoft هذا الأمر كخطأ برمجي يحتاج لإصلاح، بل كإساءة استخدام للميزات. وتوصي الشركة المؤسسات باستخدام أجنحة أمان شاملة تراقب سلوك التطبيقات وتقيد وصول الذكاء الاصطناعي للوظائف الضرورية للعمل فقط.

رأيي التقني

إن تحويل وكلاء الذكاء الاصطناعي (AI Agents) إلى وكلاء للشبكات الخبيثة كان تطوراً حتمياً في حروب الفضاء السيبراني. ومع توجهنا نحو نماذج ذكاء اصطناعي أكثر استقلالية وقدرة على تنفيذ الإجراءات نيابة عن المستخدمين، تتلاشى الحدود بين المساعد الرقمي والمخترق الداخلي. يجب على شركات الأمن السيبراني الإسراع في تطوير "جدران حماية للذكاء الاصطناعي" (AI Firewalls) تعمل كطبقة وسيطة لتنقية الأوامر والردود في الوقت الفعلي، لأن الثقة العمياء في النطاقات الكبرى ستظل ثغرة يستغلها المهاجمون بلا هوادة.